‘CVPR2018’에서 들여다본 컴퓨터 비전을 위한 AI의 현재와 미래

IEEE Conference on Computer Vision and Pattern Recognition (CVPR)는 컴퓨터로 이미지와 영상을 처리하는 다양한 방법론과 응용에 관한 논문을 발표하며 서로 교류하는 대표적인 학회입니다.

[그림 1] CVPR2018의 학회 로고 - http://cvpr2018.thecvf.com/

[그림 1] CVPR2018의 학회 로고 - http://cvpr2018.thecvf.com/

Nature, Science 등을 포함한 저명한 저널 순위표에서 20위를 차지할 정도로 높은 권위를 갖고 있죠. Salt Lake City에서 개최된 이번 CVPR2018에서는 총 979편의 논문이 발표되었고 참석자도 8000명이 넘었습니다. 기업체에서도 지대한 관심을 갖고 있어 삼성전자, 구글, 아마존, 페이스북 등을 포함한 115개 회사가 학회를 지원하며 각 회사의 관심 분야를 홍보하는 한편, 관련 연구자들을 채용하기 위한 노력도 펼쳐졌죠.

[그림 2] CVPR2018에서의 포스터 발표

[그림 2] CVPR2018에서의 포스터 발표

필자는 본 학회에서 “Context-aware Deep Feature Compression for High-speed Visual Tracking” 이라는 주제의 논문을 발표했고 1년 내 박사 학위 취득자에 한해 진행되는 Doctoral Consortium에서도 발표할 기회를 얻었습니다. 논문발표에서는 뉴럴 네트워크를 특정 물체에 최적화되도록 압축시켜 초당 100 프레임이 넘는 빠른 속도로 물체를 추적하는 새로운 방법론을 제안했습니다. Doctoral Consortium에서는 제가 지난 3년간 CVPR에서 발표했던 실시간 물체 추적 논문들을 집대성하여 실시간 물체 추적을 개발할 때 필요한 노하우와 앞으로 추구해야 할 방향성을 제시했습니다.

필자가 이번 CVPR2018에서 느낀 바는 컴퓨터 비전 연구의 최근 주요 관심사가 Generative Adversarial Network (GAN)의 다양한 활용에 있다는 것입니다. GAN은 Generator와 Discriminator의 두 가지 네트워크로 구성되어 있습니다. Discriminator는 Generator에서 만들어진 데이터와 실제 데이터를 잘 구분하도록 학습하고, Generator는 Discriminator가 데이터를 구분하는 방법을 역으로 계산하여 구분하기 어려운 데이터를 만들어내도록 학습합니다. 이 학습 과정을 반복하여 Generator로 실제 데이터와 유사한 데이터를 만들어내는 것이 GAN 최종 목표입니다. GAN 자체는 작년 CVPR에서도 화두였지만 당시 GAN 관련 CVPR 논문들은 많은 데이터를 기반으로 우리가 보지 못한 새로운 이미지를 만들어내는 접근법이나 이를 위한 안정적인 학습법들을 소개하는 것들 위주였습니다. 반면 CVPR2018의 GAN 관련 논문들은 앞서 연구된 GAN을 다양한 분야에 응용하는데 초점이 맞춰져 있습니다. 기존 불안정했던 GAN 학습이 많은 연구를 통해 비교적 쉽게 적용이 가능해졌고 다양한 분야의 연구자들이 GAN 작동 원리에 대한 이해도가 높아지면서 단순히 이미지를 만들어내는 방법론에서 벗어나 폭넓은 사용처를 찾게 된 것입니다.

다양한 활용법의 하나로 GAN 구조를 가장 적극적으로 활용하고 있는 Unsupervised Domain Adaptation (UDA)가 있습니다. UDA는 ImageNet과 같이 모든 이미지에 정답이 정해져 있는 큰 데이터 셋으로 학습된 뉴럴 네트워크를 정답이 존재하지 않으면서 다른 환경에서 촬영된 다른 데이터 셋에서도 좋은 성능을 보일 수 있도록 업데이트해주는 방법론입니다. 최근 많은 UDA 논문들이 GAN과 같이 뉴럴 네트워크를 Generator와 Discriminator 구조로 나누어서 업데이트합니다. Generator는 두 데이터 셋에서 얻은 특징들이 비슷해 보이도록 학습하고 Discriminator는 현재 입력된 이미지가 두 데이터 셋 중 어느 데이터 셋에서 나온 것인지를 구분하기 위해 학습합니다. GAN과 마찬가지로 이 학습과정이 반복되면서 서로 다른 두 데이터 셋에서 얻은 특징이 서로 유사해져 두 데이터 셋에 대해 모두 강인한 뉴럴 네트워크가 학습됩니다. 아직 만족스러운 성능을 내지 못하지만 이를 기본 알고리즘으로 삼아 10개 이상의 많은 논문들이 발표되었으며 [참고 1~8] 다양한 목적에서 UDA를 적용하기 위한 방법론들이나 UDA에서 발생하는 학습 불안정성을 해결하기 위한 노력도 이어지고 있습니다.

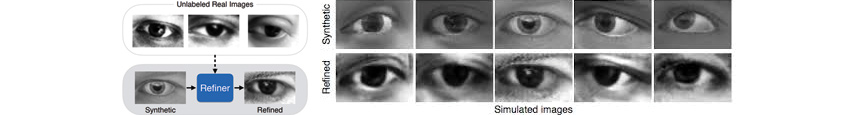

[그림 3] SimGAN의 작동 구조와 결과물 예시 [참고 9]

[그림 3] SimGAN의 작동 구조와 결과물 예시 [참고 9]

다음 활용법으로 GAN을 통해 얻은 가상의 데이터를 활용한 지도 학습(Supervised Learning)의 성능 향상 방법론들이 있습니다. 작년 Best paper를 받은 SimGAN [참고 9] 이 그 큰 방향을 잡았다고 볼 수도 있습니다. (그림 3) 해당 논문은 실제 데이터 확보에 어려움이 있었지만 Simulation을 통해 데이터를 얻기 쉬운 상황을 만들어, Simulation 데이터를 실제 데이터처럼 바꿔주는 GAN을 학습시킨 뒤 이 네트워크에서 얻은 실제 같은 가짜 데이터를 추가적으로 지도 학습에 이용해 성능을 올렸습니다. CVPR2018에서는 3D 손 모델을 GAN으로 생성해서 손 형태 추적에 활용하거나 [참고 10], 작은 얼굴에서 큰 얼굴을 GAN으로 생성해서 작은 얼굴에 대한 탐지 성능을 올리고 [참고 11], 뉴럴 네트워크가 잘 나누지 못했던 어려운 데이터를 GAN으로 생성해서 이를 학습에 다시 이용해 네트워크의 성능을 올리는 [참고 12] 등의 다양한 방법론들이 제안되었습니다. 그 외 활용법으로 CCTV 환경에서 이동하는 사람들의 이동 방향을 추정하기 위한 GAN을 적용한 방법론 [참고 13] 이 있으며, 이미지 상의 빗방울을 제거하거나 [참고 14] 촬영 노이즈 제거 [참고 15], 비정상 상황 탐지 [참고 16]를 위해서 GAN을 적용한 방법론들도 있습니다.

이번 CVPR의 Best paper award는 Stanford의 Taskonomy [참고 17]가 받았습니다. 해당 논문은 Computer vision 분야에 존재하는 여러 가지 방법론(예. Object classification, Depth estimation 등)에 대해 각각 학습된 네트워크를 서로 다른 방법론에 대해 전이 학습(Transfer learning)을 했을 때 보여주는 서로에 대한 학습 의존성을 실험적으로 보여줍니다. 25개 방법론의 다양한 조합이 포함된 방대한 실험 자체에도 의미가 있지만, 본 논문이 Best paper가 되었다는 점에서 Computer vision 분야가 전이 학습에 큰 관심을 갖고 있다는 것을 확인할 수 있었습니다. 게다가 전이 학습의 일부분에 해당하는 UDA가 금년에 많은 관심을 받았다는 점 역시 맥락이 같습니다. 전통적인 지도 학습 분야가 Facebook이나 Google 등 대형 클라우드 시스템과 많은 데이터를 보유한 대형 기업들에 의해 선도되고 있기 때문에, 학계나 여타 기업들은 기 학습된 네트워크를 어떻게 활용할 것인가에 몰두할 수밖에 없게 되었습니다. 앞으로 전이 학습의 선행 기술 개발을 위한 학계와 기업들의 경쟁이 심화되면서 그 결과를 내년 CVPR에서 확인할 수 있지 않을까 조심스럽게 예견해봅니다.

[참고]

1. “Domain Adaptive Faster R-CNN for Object Detection in the Wild”, Chen et al.

2. “Maximum Classifier Discrepancy for Unsupervised Domain Adaptation”, Saito et al.

3. “Cross-domain Weakly-supervised Object Detection Through Progressive Domain Adaptation”, Inoue et al.

4. “Cross-domain Self-supervised Multi-task Feature Learning Using Synthetic Imagery”, Ren et al.

5. “Image-Image Domain Adaptation with Preserved Self-similarity and Domain-dissimilarity for Person Re-ID”, Deng et al.

6. “Learning from Synthetic Data: Addressing Domain Shift for Semantic Segmentation”, Sankaranarayanan et al.

7. “Boosting Domain Adaptation by Discovering Latent Domains”, Mancini et al.

8. “Unsupervised Domain Adaptation with Similarity Learning”, Pinheiro

9. “Learning from Simulated and Unsupervised Images through Adversarial Training”, Shrivastava et al.

10. “GANerated Hands for Real-time 3D Hand Tracking from Monocular RGB”, Mueller et al.

11. “Finding Tiny Faces in the Wild with Generative Adversarial Network”, Bai et al.

12. “Deep Adversarial Metric Learning”, Yueqi et al.

13. “Social GAN: Socially Acceptable Trajectories with GANs”, Gupta et al.

14. “Attentive Generative Adversarial Network for Raindrop Removal from a Single Image”, Qian et al.

15. “Image Blind Denoising with Generative Adversarial Network Based Noise Modeling”, Chen et al.

16. “Adversarially Learned One-class Classifier for Novelty Detection”, Sabokrou et al.

17. “Taskonomy: Disentangling Task Transfer Learning”, Zamir et al.

▶ 해당 콘텐츠는 저작권법에 의하여 보호받는 저작물로 기고자에 저작권이 있습니다.

▶ 해당 콘텐츠는 사전 동의없이 2차 가공 및 영리적인 이용을 금하고 있습니다.

최종원 박사는 삼성SDS 연구소의 인공지능연구센터 AI플랫폼Lab에서 컴퓨터 비전 및 인공지능을 연구하고 있습니다. 실시간 물체 추적, 감시형 영상 탐지 등을 전공하였고, 서로 다른 분야의 기술들을 융합하고 서로의 시너지를 키우는 알고리즘들에 많은 관심을 갖고 있습니다.