오늘은 딥페이크 사례에 대해 알아보겠습니다. GAN(Generative Adversarial Network, 생성적 대립 신경망)을 통한 AI 합성 결과물은 마치 동전의 양면과 같아요. 긍정적 측면과 부정적 측면을 함께 보여주거든요. GAN을 통해 사람 얼굴 외에도 거실, 버스, 자동차 및 주차장까지 생물과 무생물 할 것 없이 사물 이미지 생성이 가능합니다. GAN 및 관련 기술은 가상 이미지를 넘어 영상, 음성까지 그 영역이 확대되었습니다. 거의 한계가 없는 디지털 콘텐츠 제작 기술과 사업 기회를 제공하고 있는 반면 범죄에 악용되는 부정적 측면도 동시에 존재하죠.

지금부터 딥페이크 기술이 긍정적으로 사용된 사례에 대해 살펴볼 텐데요. 딥페이크 기술의 긍정적인 효과를 이이야 할 때 빠질 수 없는 부분이 ‘디지털 콘텐츠 신기술을 활용하여 고품질 미디어를 구현했다’는 점입니다.

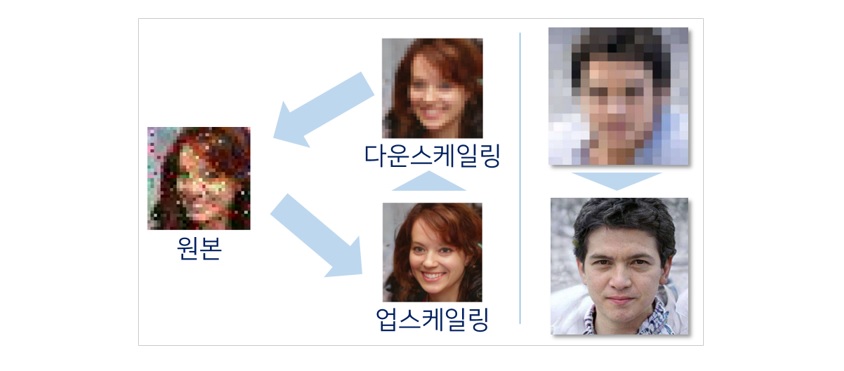

미국 듀크대학교는 ‘20년 발표한 논문에서 낮은 화질의 이미지를 업 스케일링과 다운 스케일링(1)을 반복하고 원본과 비교하면서 최적의 이미지를 생성해 내는 방법을 소개했습니다.

(1) 이미지, 동영상 등의 원본 크기를 확대(upscaling), 또는 축소(downscaling)하는 기술

산업계에서도 이와 유사한 기술들을 초고화질 TV에서 구현하고 있는데요. 글로벌 최상위 TV 제조사인 국내 S사나 L사는 AI가 학습한 영상과 사운드 기반으로 영상 품질을 최적화하고 초고화질 업 스케일링을 통해 풍부한 사용자 경험을 제공하고 있습니다. 자료 사진에서 보다시피 Full HD(가로 1,920 x 세로 1,080 픽셀 미디어)를 4K(가로 약 4,000 픽셀), 나아가 8K(가로 약 8,000 픽셀) 미디어로 실시간 확대하는 것이죠.

포토샵 등으로 유명한 Adobe가 미국 버클리 대학교와 공동 발표한 기술에서는 원본에 없는 연못을 추가하거나 촬영 시간 자체를 저녁이나 밤으로 바꾸기도 합니다. 이러한 기술은 사진이나 영화 예술 분야에서 널리 사용되고 있습니다. 다만 기존의 CG 즉, 사람의 의지로 직접 조작하는 컴퓨터 그래픽과의 구분은 점점 모호해지고 있죠.

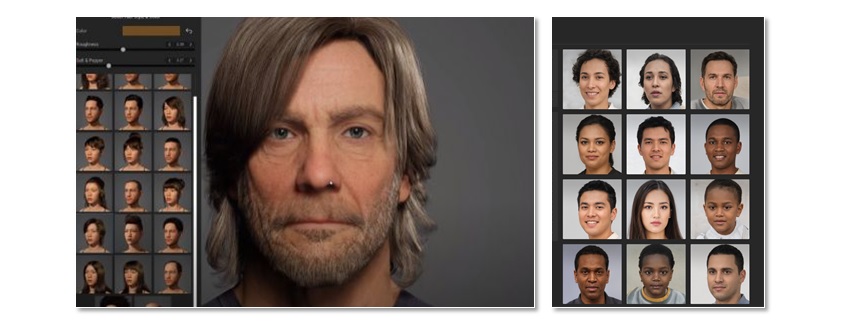

우리나라에서도 잘 알려진 Virtual Human(가상 모델)을 알아보겠습니다. 대표적인 IT 기술 분석 및 컨설팅 화사인 가트너는 가상 모델 및 관련 기술을 Digital Twin of the Person(‘20), Digital Humans(’21) 등으로 분류하면서 향후 5~10년 내 도래할 기술로 전망했는데요. 미국, 우리나라와 같은 IT 선진국에서는 이러한 Virtual Human이 보다 일찍부터 사용되고 있었습니다. (사실상 버추얼 휴먼이었던 사이버 가수 Adam을 기억하시나요?! 우리나라는 IT 선진국입니다)

GAN(Generative Adversarial Network) 기반의 가상 인물 이미지는 인종, 성별, 나이, 표정을 마음대로 골라 만들 수 있고, 초상권과 같은 법적 이슈 없이 무한 활용이 가능하죠.

Meta Human Center (좌), Generated Photos (우) (출처: Epic Games)

Meta Human Center (좌), Generated Photos (우) (출처: Epic Games)

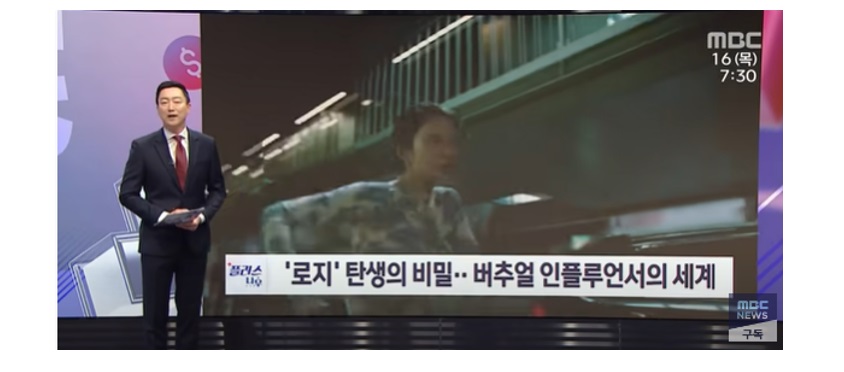

다음은 Virtual Influencer(특히 소셜 미디어에서 영향력을 발휘하는 Virtual Human)입니다. 우리나라 ‘로지’는 AI 기술과 CG를 적용해 만들어낸 22세 여성 캐릭터로 국내 S 은행 모델입니다. 로지는 자신의 인스타그램 계정에 세계 곳곳을 여행하는 사진을 올리며 인스타그램 스토리 ‘무엇이든 물어보세요’ Q&A를 통해 팬들의 질문에 답변하면서 MZ 세대 문화를 즐기는 모습을 보여주고 있죠. 특히 로지는 AI 음성 합성 기술을 활용해 목소리까지 제작하여 최초로 라디오 방송에 출연까지 했을 정도인데요. 가상 인간 로지를 기획한 ‘S 라이프’사는 약 20억 원 매출과 그 이상의 광고 효과를 이끌어내는 등 효과를 보고 있는 것으로도 알려졌습니다. 무엇보다 가상 인간 모델은 사생활 논란이나 스캔들, 학폭 등에 연루될 위험이 배제되기 때문에, 실제 사람에 비해 관련 기업의 이미지 실추 우려가 없다는 점이 장점이 될 수 있습니다.

(출처 : MBC 뉴스투데이 '21.9.16)

그 외에도 실존 아나운서 기반 AI 앵커, 대선에 등장한 AI 후보 등이 다방면에서 활약하고 있습니다. 위에서 언급한 각 이미지처럼 사람 얼굴 외에도 방, 버스, 자동차, 주차장까지 생물 및 무생물 사물의 이미지를 생성 가능한 수준입니다. GAN 결과물은 '가상의 모든 것(thisxdoesnotexist)' 사이트를 참고하세요.

다음으로 딥페이크와 관련 기술의 부정적인 사례에 대해 살펴볼게요. 미디어 합성 기술이 빠르게 고도화되면서 딥페이크와 관련한 범죄 또한 사회 전반에서 문제가 되고 있습니다. 딥러닝을 통해 만들어진 가짜 이미지와 영상, 음성 등 미디어 수준이 점차 정교해지면서 이를 악용한 가짜 뉴스, 금전 피해, 불법 음란물 등과 같은 딥페이크 범죄가 세계 각국에서 발생하고 있죠.

딥페이크 기술 사용을 통한 인물 / 환경 대체 예제 (출처 : Google Research ’21)

딥페이크 기술 사용을 통한 인물 / 환경 대체 예제 (출처 : Google Research ’21)

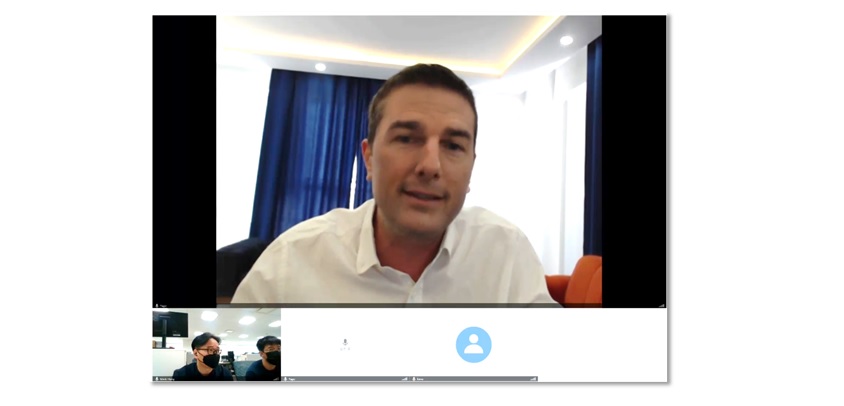

최근 미국에서는 딥페이크를 활용해 얼굴을 조작한 해커가 비대면 면접을 통과하여 기업에 위장 취업에 성공한 사건이 일어났습니다. 취업 후 해커가 내부 시스템에 대한 접근 권한을 획득한 후 기업 핵심 데이터를 빼내려고 시도한 행동까지 확인되었는데요. 미국 연방수사국(FBI) 인터넷 범죄 신고센터는 이러한 사례를 들어 자국 내 기업을 대상으로 채용 인터뷰 시 주의하도록 공문을 게시하기도 했죠. 특히 미국처럼 국토가 넓고 원격 근무가 자리 잡은 경우에는 채용 절차 대부분을 비대면으로 진행하고 있습니다. ‘DeepfaceLive’와 같은 관련 기술을 활용할 수 있는 지원자의 경우 손쉽게 딥페이크를 만들 수 있어 범죄 도구로 활용 가능해졌어요.

팀나인 파트너사가 Brity meeting 도중 실시간으로 유명인의 딥페이크를 적용한 화면

팀나인 파트너사가 Brity meeting 도중 실시간으로 유명인의 딥페이크를 적용한 화면

출처 : 1. Deepfakes and Stolen PII Utilized to Apply for Remote Work Positions(FBI 공문)

2. FBI warning: Crooks are using deepfake videos in interviews for remote gigs

한편, 성인이 청소년을 상대로 저지른 첫 딥페이크 불링 사례도 미국에서 발생했습니다. 딸이 치어리더인 이 여성은 경쟁 관계에 있는 딸 친구들과 관련된 허위 미디어를 딥페이크로 만들었는데요. 이 자료를 학교 소속팀 감독, 코치 및 친구들에게 전송했다가 체포되었죠.

(출처 : Good Morning America)

이외에도 금융 피해, 디지털 성폭력, 여론 조작, 국가 안보위협 등 다양한 딥페이크 악용 사례가 존재하고 있습니다.

현재 AI와 딥페이크 기술 발달로 가짜 미디어가 숙련된 전문가들이 걸러낼 수 있는 수준을 넘어서고 있으며, 이제는 일반 대중들도 플랫폼을 통해 직접 가짜 뉴스를 걸러낼 수 있어야 한다고 생각되는 시점입니다. 팀나인은 지속적으로 딥페이크 탐지 기술을 연구해 관련 범죄에 의한 피해를 방지하도록 노력하겠습니다. 마지막으로 여러분이 접하는 미디어가 ‘딥페이크’라고 의심될 경우 대응할 수 있는 간단한 방법을 알려드릴게요.

□ 딥페이크 미디어 대응 규칙

Inspired by Microsoft, University of Washington. Used by Permission ('21)

1. 어딘가 수상하고 딥페이크로 의심되는 미디어를 접할 경우, 이 미디어가 사회에 어떤 영향을 끼칠지 생각해 보세요.

2. 딥페이크를 구분하는 일반적인 규칙이 존재하지는 않지만 여러분을 속이려고 하는 딥페이크가 있다면,

사진이나 영상에 여러분의 감정이 어떻게 반응하는지 살펴보세요.

3. 만약 여러분이 강렬한 감정을 느끼는 사진이나 영상이 있다면,

여러분이 그렇게 느끼는 이유가 무엇일지 잠시 하던 일을 멈추고 스스로에게 물어보세요.

4. 재미있거나 뭔가 그럴듯해 보이는 사진을 별생각 없이 SNS에서 공유해 왔나요?

이제는 잠깐 그 행동을 멈추고 해당 사진이나 영상에 대해 인터넷에서 검색해 보세요.

5. 조금만 관심을 갖고 찾아보면 내가 본 이미지가 진짜가 아니라는 사실을 알게 될 수도 있습니다.

*본 연재 내용은 작성일 기준 공개된 객관적 연구 결과와 사실에 근거하여 작성되었지만, 회사의 방향과 다를 수 있음을 알려 드립니다.

+ AI를 활용한 멀티미디어 위변조에 대응하는 삼성SDS 사내벤처 팀나인

+ 누가 진짜일까? 딥페이크 생성과 탐지

+ Cheapfake(Shallowfake)란 무엇일까요?

+ 위∙변조 사전 차단이란 무엇일까요?

![]()