필자는 지난 1월 24일부터 2일간, 미국 샌프란시스코에서 열린 RE-WORK’s Deep Learning Summit 2019에 참석하였습니다. RE-WORK는 AI와 Deep Learning과 관련되어 컨퍼런스, 워크샵 등 다양한 행사를 개최하는 단체입니다. 필자가 참석한 행사는 Deep learning 분야에서는 세계에서 가장 큰 규모의 컨퍼런스라고 합니다.

Deep Learning Stage의 모습

Deep Learning Stage의 모습

Deep Learning, AI Assistant 등 AI와 관련되어 기술적인 주제들을 다루는 Stage들을 둘러보던 중 필자의 시선을 사로잡는 Stage가 있었습니다. 그것은 바로 Ethics & Social Responsibility Stage와 Environment & Sustainability Stage 였습니다.

Ethics & Social Responsibility Stage 입구에 설치된 배너

Ethics & Social Responsibility Stage 입구에 설치된 배너

사실 AI와 관련된 기술적인 소개와 적용 사례는 많은 컨퍼런스나 워크샵을 통해 소개되고 있지만 기술적인 논의를 넘어서 AI 윤리 및 사회적 책임감에 대한 주제에 대한 논의가 신선하게 다가왔습니다. 이중 필자에게 인상 깊었던 세션 일부를 소개해드리겠습니다.

# 1. Ethics & Social Responsibility Stage

' Understanding the Limitations of AI '라는 주제로 발표하는 구글 Ethical AI팀의 Timnit Gebru

' Understanding the Limitations of AI '라는 주제로 발표하는 구글 Ethical AI팀의 Timnit Gebru출처: Rework 공식 블로그(re-work.co)

연사의 소개로 시작된 본 세션은 ‘Ethical AI’라는 팀이 존재한다는 사실부터 필자에게는 놀라움 이었습니다. Timnit은 발표를 통해 AI 알고리즘에 인간의 편견이 반영 된다고 했습니다. 예를 들어 이미지 인식 AI 모델을 학습할 때 ‘프로그래머’라는 이미지를 학습시킬 때는 남자의 사진이 주로 학습되는 사례를 소개해주었습니다. 더 나아가 만약 법적인 자문이나 다른 민감한 분야에 AI가 적용되고, 이 때 인간의 편견이 그대로 학습된다면 이는 위험할 수 있다고 말하였습니다.

AI 모델을 만들고 이를 학습시키기 위한 데이터는 결국 인간(Engineer 또는 Data Scientist)의 생각이나 편향적인 사고가 반영될 수도 있기에 그 위험성에 대해서 생각해 볼 수 있는 자리였습니다.

세션을 준비하는 패널들

세션을 준비하는 패널들

발표 형식의 세션에 이어서 ‘Ethical AI: harnessing Automation for a just world’라는 주제로 Panel Discussion 세션도 진행되었습니다. Stanford 대학의 Londa Schiebinger 교수는 AI 기술이 주로 유럽, 미국 등 서구권 국가가 주도하고 있는 현재 상황에서 AI 기술이 비 서구권에도 평등하게 적용되어야 한다고 주장하였습니다.AI 기술이 sub-popular 그룹에도 평등하게 동작하도록 업계 종사자들이 항상 노력해야 한다 라는 의견에 절로 고개가 끄덕여지는 순간이었습니다.

현장에서 다양한 질문에 답하고 있는 패널들

현장에서 다양한 질문에 답하고 있는 패널들

또 다른 주제의 Panel Discussion 세션에도 참석하였는데요. 이번 주제는 ' Extended Q & A: Practical Next Steps Towards Ethical AI ' 였습니다. AI를 통한 의사결정의 책임감(Responsibility)는 누구에게 있는지에 대한 논의도 이루어 졌습니다.

AI 알고리즘을 설계한 엔지니어에게 있을까요?

아니면

이를 신뢰하고 의사결정을 한 사람에게 있을까요?

사실 AI 알고리즘 내부의 동작은 설계한 개발자도 알 수 없기 때문에 그 책임감과 관련하여 생각해봐야 한다는 의견이 인상적이었습니다. 또한 Northern Illinois 대학교의 David Gunkel 교수는 ‘Cortana, Alexa 등 인공지능 비서는 단순한 도구가 아닌 도구와 인간 그 사이에 있는 하나의 객체(Entity) 이다.’ 라고 하였습니다. 말하는 사람의 감정과 과거의 데이터를 통해 개인화된 적절한 응답을 하는 인공지능 비서를 과거 컴퓨터와 휴대 폰과 같은 단순한 도구로 취급할 수는 없다는 의견이 인상적이었습니다.

# 2. ENVIRONMENT & SUSTAINABILITY STAGE

발표 자료 중 일부, 출처 : Rework 공식 블로그(re-work.co)

발표 자료 중 일부, 출처 : Rework 공식 블로그(re-work.co)

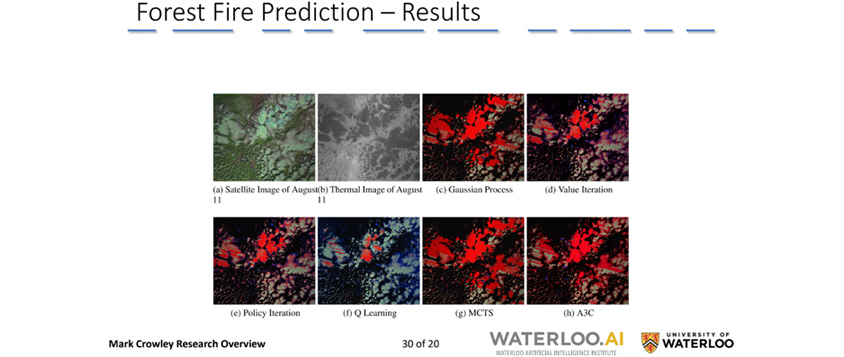

환경 분야의 AI 적용과 관련한 Stage도 있었습니다. Waterloo 대학의 Mark Crowley 교수는 발표를 통해 인공위성의 사진을 AI 알고리즘을 통해 분석하여 이를 산불 확산 경로를 예상하는데 적용한 사례를 소개하였습니다. 산불의 위험도를 예상하고 확산이 되지 않을 것 같다면 굳이 대응하지 않고 방치할 수 있으며 이를 통해 수백만 달러의 세금을 절약할 수 있다는 발표였습니다. 또한 University of California, San Diego의 David Kriegman 교수는 산호 생태계 연구에 AI를 적용한 사례도 소개하였습니다. Conventional Vision 기술을 적용하여 산호 사진만 보고 AI를 통해 종류를 라벨링 할 수 있는 흥미로운 이야기였습니다.

느낀점

최근 몇 년간, Deep Learning이 급격하게 발전하면서 다양한 분야에 이를 도입하는 시도가 이루어지고 있습니다. 대표적으로 이미지 인식 기술이나 많은 IT회사들이 시도하는 AI Assistant 분야에서 상용화된 솔루션들이 나오고 있습니다.

Rework Deep Learning Summit은 이러한 기술적인 소개 및 적용 사례의 발표뿐만 아니라 Ethics & Environment Stage를 통해 AI 관련 학계나 업계 종사자들이 인류에 대한 책임감과 윤리의식에 대한 고민을 들을 수 있는 자리였습니다.

이러한 논의들을 통해 AI 기술이 인류에 미치는 부정적 영향을 항상 주의한다면, 컴퓨터, 스마트폰이 가져온 변화보다 더 큰 긍정적 변화를 인류에게 선물해주지 않을까 생각하면서 Rework Deep Learning Summit 2019 후기를 마칩니다.

▶ 해당 콘텐츠는 저작권법에 의하여 보호받는 저작물로 기고자에 저작권이 있습니다.

▶ 해당 콘텐츠는 사전 동의없이 2차 가공 및 영리적인 이용을 금하고 있습니다.

![]()

삼성SDS 보안사업부 보안플랫폼팀

보안 관제를 위한 플랫폼 개발 및 운영 업무를 맡고 있습니다.