Untact 시대, 사람 중심 Untact를 경험하고 있나요?

우리의 일상과 업무는 코로나로 인해 순식간에 디지털로 전환(Digital Transformation) 되었습니다. 재택근무가 일반화되고 첨단 신기술이라 불리는 로봇, 빅데이터, AI, 클라우드 등이 속속 일상화되면서 사람들도 빠르게 비대면(Untact) 디지털 환경을 경험하고 있습니다. 하지만, 비대면 디지털 경험의 확산은 사람들에게 새로운 적응력을 요구하고 있습니다. 서로 대면하면서 자연스럽게 소통하던 방식에서 각자의 공간에서 스크린에 몰입하면서 더 효율적이면서 생산적인 소통을 요구받고 있습니다.

기업의 리더들 또한 이러한 비즈니스 환경과 고객 경험의 변화를 감지하며 대응하고 있습니다. 남들보다 빠르게 첨단 기술을 도입하고 직원과 고객의 높아진 기대치를 맞추기 위해 노력하고 있습니다. 특히, “경험”은 새로운 기업의 경쟁적 우위요소임을 알고 있기에 단순히 기술을 도입하는 데 그치지 않고 사용자(임직원과 고객)에 대한 섬세한 탐색과 해석 그리고 충분한 이해가 함께 수반되어야만 사용자들로부터 선택받을 수 있음을 인식하고 있습니다.

가트너에서 발표한 2021년 9가지 기술 트렌드(Gartner Top Strategic Technology Trends 2021)는 기술 자체보다 기술을 사용하고 경험하는 “사람”이 비즈니스의 “중심”(People centricity)이 되어야 함을 강조하고 있습니다. 비즈니스 가치사슬 상에서 각각 분산되어 개선하던 고객 경험(Customer Experience), 임직원 경험(Employee Experience), 사용자 경험(User Experience)을 통합하여 총체적 경험(Total Experience)으로 개선하는 데 초점을 맞추어야 타 기업들이 모방할 수 없는 경쟁력을 갖추는 것이라고 합니다.[1]

이에 본 리서치에서는 먼저 사람과 사람을 온라인으로 이어주는 경험에 대해 다루고자 합니다. 특히, 비즈니스 가치 창출자이자 제공자인 회사 임직원들이 경험하고 있는 원격 재택근무를 분석하고 개선 포인트를 제공하여 기업의 지속적인 생산성 향상에 기여할 수 있는 부분을 찾고자 합니다.

화상 회의에서 카메라를 켜지 않고 상대방의 감정과 의도를 파악하는 법

“다들 이해되세요?”

그 어느 때보다 온라인 회의를 많이 하는 지금, 이전에는 자연스럽게 알 수 있었던 상대방의 감정이나 의도를 알기가 어려워졌고 커뮤니케이션은 복잡해졌습니다. 만나서 대화하면 자연스럽게 이해할 수 있었던 얼굴 표정, 시선, 자세, 몸짓과 같은 비언어적 단서를 짐작과 추측으로 해석해야 하기 때문입니다. 메라비언의 법칙에 따르면, 커뮤니케이션 중 상대방의 언어를 이해하는 비중은 7%에 불과하며 나머지 93%는 표정, 시선, 자세, 몸짓과 같은 비언어적 커뮤니케이션(Nonverbal communication)에 의존한다고 합니다.[2] 이러한 이유로 얼굴이 안 보이는 상황에서 대화할 때 서로가 알 수 없는 부정적인 감정이 쌓이거나, 잠시 머뭇거리거나 침묵하는 1.2초 동안 집중력이 떨어지기도 합니다.[3]

카메라를 켜면 되지 않나요?

온라인 회의에서 이러한 문제점을 해결하기에 가장 손쉬운 방법은 카메라를 켜는 것입니다. 비언어적 표현 93% 중 시각적인 측면이 55%를 차지하므로 얼굴을 보기만 해도 대화의 반 이상은 쉬워질 수 있습니다. 그리고 상대방의 얼굴 표정을 보는 것은 상호 이해와 공감을 높이고 서로가 연결된 것처럼 느끼게 합니다.

하지만, 카메라를 켜면 모든 게 해결될까요?

최근 온라인 회의에서 카메라를 켜는 것에 대한 의견이 엇갈리기 시작했습니다.[4] 온라인 회의를 하는 동안 지저분한 집이나 흐트러진 옷이 비춰지는 부담감이 재택근무 중인 직장인에게 스트레스로 작용한다고 합니다. BBC 워크라이프는 사람들의 부담감을 이렇게 대변했습니다. “모든 사람이 나를 보고 있기 때문에 마치 무대에서 공연하는 듯한 압박감을 느낀다.” 이는 발언하는 것보다 카메라 앞에서 어떻게 행동해야 할지 의식하는 게 더 크고, 회의에 집중하기 어렵다는 걸 시사합니다.[5] 회의에 집중하기 어려워지면 상대방의 비언어 커뮤니케이션을 이해하는 데 부담이 가중될 수밖에 없습니다.

스탠퍼드대학교의 심리학과 교수인 Wagner는 회의 내용을 이해하면서 카메라까지 보는 것은 멀티테스킹을 가중해 집중력과 기억력을 저하한다고 밝혔습니다.[6] Microsoft의 Human Factors Lab는 화상 회의 시 스크린에 집중해 비언어적 단서를 찾는 행동이 대면 회의에서보다 스트레스를 높인다고 발표했고,[7] 노트북 카메라는 얼굴만 비추기 때문에 자세, 몸짓과 같은 신체 언어를 이해하기 어려워 공감 능력을 떨어뜨리고 감정을 숨기기 쉽다는 연구도 있습니다.[8]

이는 카메라만으로 비언어적 표현을 해석하기에 한계가 있으며 온라인 회의에서 카메라를 켜는 것은 선택사항이어야 함을 의미합니다. 그렇다면 온라인 회의에서 카메라를 끄고도 팀원의 비언어적 표현을 이해하여 원활할 커뮤니케이션을 하는 방법은 어떤 것이 있을까요? 실제 사례와 연구 결과를 살펴보고 우리에게 적용 가능한 방법을 제안합니다.

Solution ① 눈치로 정했던 참석자의 R&R을 회의 전 미리 정해주세요!

여러 사람이 논의하는 그룹 회의에서는 본인이 발언하지 않을 때 주의력이 떨어지며, 주관자와 회의록 작성자 등 참석자들 간의 역할이 불분명할수록 회의가 비효율적으로 진행될 수 있습니다. 퍼실리테이션 전문가 Metz는 회의 생산성과 집중력을 높이기 위해 사전/사후 준비를 철저하게 할 것을 제안합니다.[9]

먼저 회의 시작 전 안건과 목표, 소요 시간을 공유해 주세요. ‘오늘의 안건’ 칠판에 참석자의 발언 순서를 정하고, 회의록 작성자를 지정해 역할을 분담하세요. 정해진 순서대로 발언자의 마이크와 화면 공유를 켜는 기능을 도입할 수 있습니다.

다음으로 회의 중에는 언제든지 회의 정보를 확인할 수 있는 장치를 두세요. Zoom, Webex 등 많은 솔루션이 회의 제목을 확인할 수 있지만, 진행 중에 상세 안건과 역할자를 확인할 순 없습니다. 회의 중간에 접속한 참가자는 목적을 모른 채 수동적으로 참여하게 됩니다. 이를 개선하려면 회의 입장 전 대기실에서 회의 주제와 주관자를 인지한 후 입장하는 서비스를 도입해야 합니다.

마지막으로 회의 종료 후 1시간 이내에 결정 사항에 대한 후속 업무를 공유하세요. 회의록 작성자로 지정된 사람은 Action item을 작성한 후 직접 공유하거나, 공유를 자동화하는 것도 좋은 방법입니다.

Solution ② 완벽한 나의 모습을 대신할 아바타를 사용하세요!

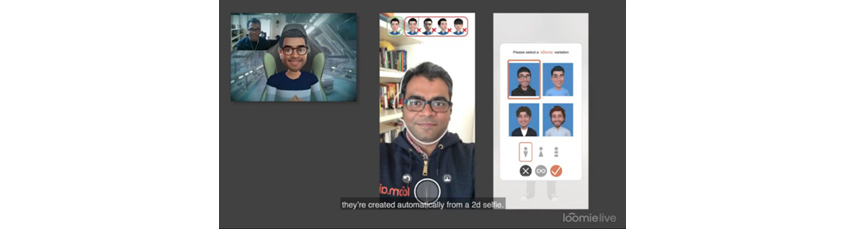

불특정 다수가 모이는 컨퍼런스에서 나와 유사한 모습을 한 아바타로 참석하세요. 샌프란시스코에 위치한 Loom.ai는 사용자의 표정과 음성을 카메라로 촬영하고 AI 딥러닝 알고리즘으로 얼굴 전체와 상반신을 애니메이션으로 만드는 서비스를 선보였습니다. 자신만의 캐릭터를 만드는 SNOW(네이버 자회사)의 ZEPETO와 달리, Loom은 외모의 유사성을 유지하면서 정서적 표현을 거의 완벽하게 재현했습니다. 이는 아바타가 개인화되고 있으며, 비언어적 표현을 대신 전달하는 수단임을 보여줍니다.

카메라로 촬영된 내 얼굴과 유사한 아바타를 생성(출처:Loom.ai)[10]

카메라로 촬영된 내 얼굴과 유사한 아바타를 생성(출처:Loom.ai)[10]

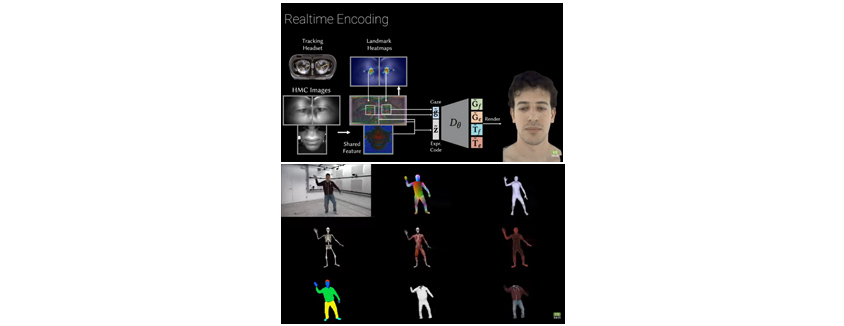

보다 실사에 가깝게 제작하는 아바타를 포토 리얼리스틱 아바타라고 합니다. Facebook은 아직 프로토타입이지만 표정은 물론 시선, 어조, 톤을 정교하게 복제하고 나아가 골격과 근육을 추적하는 바디 트래킹까지 시도하고 있습니다.

Facebook VR Research: Photorealistic Face & Body Tracked Avatars[11]

Facebook VR Research: Photorealistic Face & Body Tracked Avatars[11]

단순 캐릭터형 아바타가 포토 리얼리스틱 아바타로 변화하는 이유는 몰입도 때문입니다. 경희대학교 산학협력단의 이두황 교수가 발표한 자아 몰입감 관련 보고서에 따르면, 자신이 닮고 싶은 이상형이나 유명인의 얼굴보다는 자신의 얼굴과 흡사한 아바타를 사용할 때 몰입과 관련한 뇌 전위 진폭을 생성하는 걸 발견했습니다.[12]

포토 앱이나 게임 등에 주로 사용하던 아바타는 비즈니스와 컨퍼런스 사업으로 확장되고 있습니다. 영업이나 MD 등 실제 상품 샘플을 이미지로 업로드하면, 3D 이미지로 구현되어 상품을 360도 시연할 수 있는 Spatial 사례가 그 예시입니다. 또한 코넬대학교에서 발행한 리포트에 따르면, 아바타는 불특정 다수가 참여하는 라이브 컨퍼런스에 활용되는 장기적인 도구가 될 것이라고 주장합니다. 가상환경에 전시 부스나 포스터를 시연하면 사용자가 주위로 모여 관람하고, 그 주위에 모인 참가자는 비슷한 관심사를 논하며 소통할 수 있기 때문입니다.[13] 이렇게 시각적인 자료를 함께 보고 설명하기 위한 상황은 팀원 간 협업에서도 발생하는데요. 이는 5번째 솔루션에서 자세하게 설명하겠습니다.

Solution ③ 어떤 순서로 손을 들었는지 보여주세요!

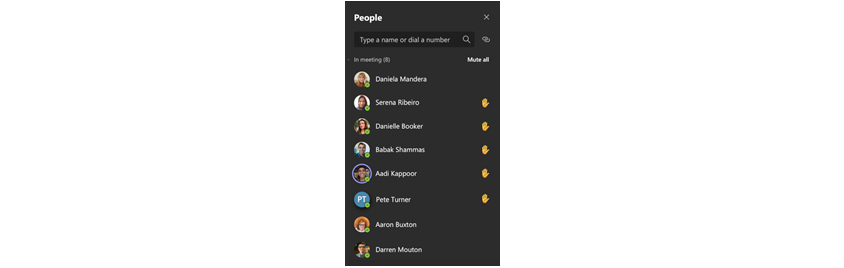

손들기 버튼은 발언권을 얻기 위한 좋은 시도입니다. Zoom, Microsoft Teams 등 많은 솔루션은 이미 손들기 버튼을 적용하고 있습니다.

손들기 한 참여자 목록(출처: Microsoft Teams)[14]

손들기 한 참여자 목록(출처: Microsoft Teams)[14]

하지만 발표자 입장에서는 손들기 알림을 동시다발적으로 받아 누가 먼저 손을 들었는지 알기가 어렵습니다. 손들기 버튼 대신 직접 손드는 것을 AI가 인식해 카메라를 켜는 방법도 제안되었는데, 최근 HCI Korea 2021에서 실험 결과 손들기 버튼이 더 효과적이라고 발표했습니다. 직접 버튼을 누를 때 더 높은 사회적 실재감, 몰입감, 참여도를 나타낸 것입니다.[15]

이를 토대로 우리는 손들기 버튼을 보다 적극적으로 활용해야 함을 알 수 있습니다. 참석자가 버튼을 클릭한 순서를 시각적으로 표시해 주세요. 손들기 외에도 이해도, 관심도 버튼을 신설하고 1~5점 수치를 입력하는 등 여러 방법을 응용해 보세요.

Solution ④ 감정을 표현하는 이모지(Emoji) 비중을 확대하세요!

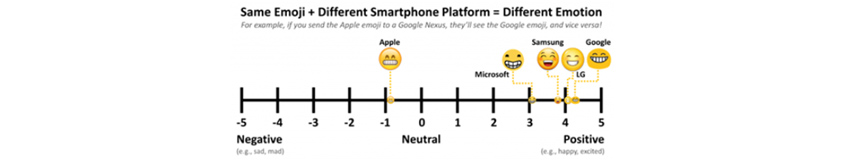

온라인 미팅에서 이모지는 감정을 말로 표현하는 것보다 전달력이 빠릅니다. 아니, 얼굴 표정을 보고 감정을 캐치하는 속도와 같습니다. Computers in Human Behavior 저널에서 Kaye는 발신자의 얼굴-이모지-감정 문구를 보고 수신자가 감정을 이해하는 속도에 관해 비교 연구를 발표했습니다. 그 결과, 얼굴 표정과 이모지로 감정을 해석하는 속도는 같으며 채팅을 읽는 속도는 가장 느렸습니다. 이는 이모지가 비언어적 표현 중 정서적인 역할을 충분히 수행할 수 있음을 시사합니다.[16] 다만 남자와 여자가 이모지를 선택하는 데 차이가 있다는 연구가 있으며,[17] 같은 표정의 이모지를 사용해도 사람마다 받아들이는 감정의 정도가 다르다는 한계도 있습니다.[18]

‘웃는 얼굴’의 이모지가 스마트폰마다 해석되는 정도의 차이 비교 실험(출처: Miller, H., 2016)[19]

‘웃는 얼굴’의 이모지가 스마트폰마다 해석되는 정도의 차이 비교 실험(출처: Miller, H., 2016)[19]

Brity Messenger 이모지를 예로 들어보겠습니다. 모두 입을 벌리며 웃는 표정임에도 감정의 정도가 다르게 느껴지지 않나요?

Knox/Brity messenger 이모지

Knox/Brity messenger 이모지

하지만 수신자 입장에서는 긍정의 표시로 이해할 수 있습니다. 회의 중 감정을 빠르게 전달하는 목적으로 사용한다면, 이모지는 감정을 표현하는 가장 강력한 수단이 될 수 있습니다.

Solution ⑤ 누가, 어디를 보고 가리키는지 화면에 표시해 주세요!

화이트보드나 브레인스토밍같이 한 화면을 공유하고 협업하는 상황에 해당합니다. 노스웨스턴 대학교의 D’Angelo는 원격 협업 시 제스처와 시선을 시각화했을 때 커뮤니케이션 인지 능력과 협업을 강화할 수 있다고 입증했습니다.[20] 그 중 제스처가 가장 효과적인데 작업물을 가리키거나 선을 긋는 행동은 발언 순서와 의도를 표현하고 논의 시간을 단축한 것으로 나타났습니다.[21] 실제로 MindMeister는 팀원이 클릭하거나 타이핑한 영역을 시각적으로 표현해 효과적인 마인드맵 협업 툴로 부상했습니다.

협업자가 입력한 문구에 프로필 사진이 표시(출처: MindMeister)[22]

협업자가 입력한 문구에 프로필 사진이 표시(출처: MindMeister)[22]

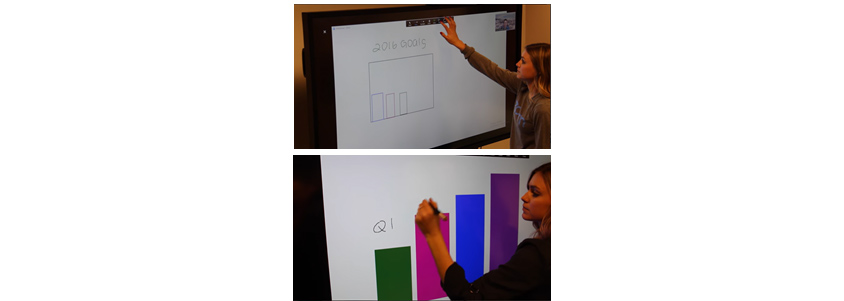

원격 환경에서의 협업 툴은 시각적 결과물을 다루는 디자인이나 건축 분야에 적합한 것으로 보이지만,[23] Zoom은 일반 사무직에서도 가능합니다. 화상 회의 중 화이트보드 모드로 전환하여 참가자에게 텍스트와 도표를 그리며 설명을 보강하는 예시가 그것입니다.

터치스크린으로 더욱 쉬워진 대화형 공동 작업(출처: Zoom)[24]

터치스크린으로 더욱 쉬워진 대화형 공동 작업(출처: Zoom)[24]

협업 툴은 더 이상 온라인 회의와 분리된 영역이 아닙니다. 온라인 회의에 협업 모드를 신설하여 공유 화면에 집중하는 환경을 만들어주세요. 공유 화면에 집중하기 위해 시선 추적 기술(Eye Tracking)을 활용할 수 있습니다. 화상 회의와 증강현실(AR) 기술을 결합한 증강 화상 회의에서 서로의 초점이 머물거나 시선이 이동하는 경로를 표시하는 것입니다. 이는 암묵적으로 드러나지 않던 자신의 의도를 서로에게 명확히 전달하여 커뮤니케이션 시간을 줄이고, 집중력을 향상할 수 있습니다.[25] 협업 외 교육 분야에서는 학습자와 교수자 간의 상호작용을 높이는 데 활용하고 있습니다. 교육 자료에 대한 시각적 관심도를 수치화하여 학습 자료를 개선하거나, 학습 성취도를 분석하는 데 활용합니다.[26] 이처럼 제스처와 시선을 시각화하여 자신의 의도를 전달하고 상호 커뮤니케이션을 강화하는 것은 더 나은 결과물을 만들기 위한 방법의 하나입니다.

우리의 제안

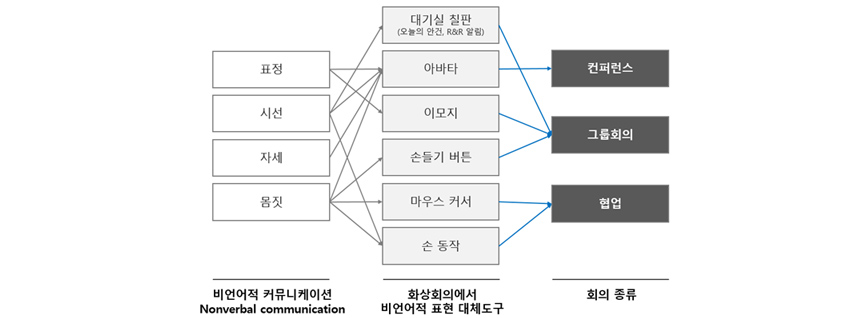

비언어 커뮤니케이션을 이해하려는 노력은 결국 회의를 원활하게 진행하기 위해서입니다. 매끄러운 회의 진행을 위해 기업들은 여러 시도를 하지만, 고객의 상황을 100% 이해하고 만족시킨 기업은 아직 없습니다. 왜냐하면 비언어적 표현은 한가지 도구로 해결되지 않기 때문입니다. 몸짓을 알아차리기 위한 방법만 해도 아바타, 손들기 버튼, 마우스 커서, 손동작 등 다양하기 때문입니다.

우리는 이 도구들을 어떤 회의에 적용했을 때 효과적인지 고민해야 합니다. 아바타를 예로 들어보겠습니다. 팀원 간 얼굴을 이미 알고 있는 상태에서 아바타는 단순 엔터테인먼트로 소비될 수 있습니다. 이런 상황에서 그룹 회의를 할 때에는 아바타보다 이모지가 감정을 알리기 위한 도구로 더 적절하다고 할 수 있습니다.

- 비언어적 커뮤니케이션 Nonverbal communication

- 표정, 시선, 자세, 몸짓

- 화상회의에서 비언어적 표현 대체도구

- 대기실 칠판(오늘의 안건, RnR 알림), 아바타, 이모지, 손들기 버튼, 마우스 커서, 손 동작

- 회의 종류

- 컨퍼런스, 그룹회의, 협업

고객은 그룹 회의, 컨퍼런스, 협업 등 다양한 회의에 참석하는 가운데, 이 회의에 참석하는 사용자들의 유형 또한 다양합니다. 이렇게 복잡하고 다양한 환경에 대응하려면 회의 성격에 맞는 기능을 맞춤 제공하는 게 좋습니다. 회의 개설 시 고객이 직접 회의 종류를 고르고 우리는 그에 맞는 비언어적 표현 대체 도구를 제공하는 것입니다. 수많은 화상 회의 솔루션이 쏟아지는 지금 고객을 가장 잘 이해하고 필요한 서비스를 제공하는 솔루션만이 선택 받을 수 있을 것입니다.

1호 화상 회의에서 카메라를 켜지 않고 상대방의 감정과 의도를 파악하는 법이 끝났습니다.

다음 리포트에서 계속됩니다.

References

[1] Gartner Top Strategic Technology Trends for 2021, 2020. URL//www.gartner.com/smarterwithgartner/gartner-top-strategic-technology-trends-for-2021/ (accessed 2.18.21).

[2] Mehrabian, A., 1971. Silent messages, in: Silent Messages. Wadsworth Publishing Company, p. 152.

[3] Schoenenberg, K., Raake, A., Koeppe, J., 2014. Why are you so slow? – Misattribution of transmission delay to attributes of the conversation partner at the far-end. International Journal of Human-Computer Studies 72, 477–487. https://doi.org/10.1016/j.ijhcs.2014.02.004.

[4] Park, S.Y., Whiting, M.E., 2020. Beyond Zooming there: Understanding nonverbal interaction online.

[5] Jiang, M., n.d. The reason Zoom calls drain your energy [WWW Document]. URL https://www.bbc.com/worklife/article/20200421-why-zoom-video-chats-are-so-exhausting (accessed 2.4.21).

[6] Uncapher, M., Wagner, A., 2018. Minds and brains of media multitaskers: Current findings and future directions. Proceedings of the National Academy of Sciences 115, 201611612. https://doi.org/10.1073/pnas.1611612115.

[7] Jared, S., 2020. The future of work—the good, the challenging & the unknown.

[8] Schoenenberg, K., Raake, A., Koeppe, J., 2014. Why are you so slow? – Misattribution of transmission delay to attributes of the conversation partner at the far-end. International Journal of Human-Computer Studies 72, 477–487. https://doi.org/10.1016/j.ijhcs.2014.02.004.

[9] Metz, T., 2020. Research consistently reports that the three biggest, post Covid-19 challenges of leading online meetings are.

[10] Loom.ai, n.d. LoomieLive Zapp on Zoom! Loom.ai. URL https://youtu.be/-DyizqHKtWI (accessed 10.17.20).

[11] Heaney, D., 2020. Facebook’s Prototype Photoreal Avatars Now Have Realistic Eyes. Uploadvr. URL https://uploadvr.com/frl-codec-avatars-new-eyes/, https://youtu.be/Q-gse_hFkJM.

[12] 경희대학교 산학협력단, 2015. 공존감 생성을 위한 사회적 요인 및 실현 방법론 개발 (No. 2012M3A6 A3057090). 미래창조과학부.

[13] Bonifati, A. et al. (2020) ‘Holding a Conference Online and Live due to COVID-19’, arXiv preprint arXiv:2004.07668.

[14] Microsoft Teams, n.d. Raise your hand in a Teams meeting. Mircosoft Support. URL https://support.microsoft.com/en-us/office/raise-your-hand-in-a-teams-meeting-bb2dd8e1-e6bd-43a6-85cf-30822667b372.

[15] 신효림, 김시완, 최준호., 2021. 실시간 온라인 강의 플랫폼의 인터랙션 디자인 제안: 학습자 참여와 몰입을 위한 인공지능 자동화 인터페이스 실험 연구. 2021 The HCI Society of Korea.

[16] Kaye, L., Rodriguez-Cuadrado, S., Malone, S., Wall, H., Gaunt, E., Mulvey, A., Graham, C., 2020. How emotional are emoji?: Exploring the effect of emotional valence on the processing of emoji stimuli. https://doi.org/10.31219/osf.io/daf6b.

[17] Jones, L.L., Wurm, L., Norville, G., Mullins, K.L., 2020. Sex differences in emoji use, familiarity, and valence. Comput. Hum. Behav. 108, 106305.

[18] Girardin, L., 2020. THE 7 BARRIERS TO DIGITAL COMMUNICATION.

[19] Miller, H., Thebault-Spieker, J., Chang, S., Johnson, I., Terveen, L., Hecht, B., 2016. “Blissfully happy” or “ready to fight”: Varying Interpretations of Emoji.

[20] D’Angelo, S., Gergle, D., 2018. An Eye For Design: Gaze Visualizations for Remote Collaborative Work. https://doi.org/10.1145/3173574.3173923.

[21] Park, N., Kim, B.-G., Kim, J., 2019. A Mechanism of Masking Identification Information regarding Moving Objects Recorded on Visual Surveillance Systems by Differentially Implementing Access Permission. Electronics 8. https://doi.org/10.3390/electronics8070735.

[22] MeisterTask, 2015. MindMeister & MeisterTask: How to turn your ideas into action. MeisterTask. URL https://youtu.be/c9P0Lq76Tmo.

[23] Wardak, D., 2016. Gestures orchestrating the multimodal development of ideas in educational design team meetings. Design Studies 47, 1–22. https://doi.org/10.1016/j.destud.2016.08.001.

[24] Zoom, 2016. Zoom for Touch. Zoom. URL https://youtu.be/gezS90Pg_fk (accessed 2.22.21).

[25] Gupta, K., Lee, G.A., Billinghurst, M., 2016. Do You See What I See? The Effect of Gaze Tracking on Task Space Remote Collaboration. IEEE Transactions on Visualization and Computer Graphics 22, 2413–2422. https://doi.org/10.1109/TVCG.2016.2593778

[26] VandenPlas, J., n.d. How eye tracking can inform discipline based educational research. Tobii Pro. URL https://www.tobiipro.com/ko/blog/how-eye-tracking-can-inform-discipline-based-educational-research/ (accessed 3.19.21).

▶ 해당 콘텐츠는 저작권법에 의하여 보호받는 저작물로 기고자에게 저작권이 있습니다.

▶ 해당 콘텐츠는 사전 동의 없이 2차 가공 및 영리적인 이용을 금하고 있습니다.

![]()

Digital Transformation 환경에서 고객 가치를 혁신하는 CX 전략을 제안하고 사용자의 컨텍스트에 기반한 최적의 고객 경험을 설계합니다.